Zwei Jahre nach dem Durchbruch von ChatGPT stehen Unternehmen vor einem unsichtbaren, aber grundlegenden Wendepunkt: Künstliche Intelligenz hört 2026 auf, ein Werkzeug zu sein, das man einmal anruft, und wird zu einem mitdenkenden System, das kontinuierlich arbeitet, lernt und handelt. Diese Entwicklung — getrieben von persistenten Memories, modularen Skills und autonomen Agenten — ist nicht nur ein Produktivitätsupdate; sie verändert Geschäftsmodelle, Informationsarchitekturen und die Rolle des Menschen in der Arbeit radikal. com]

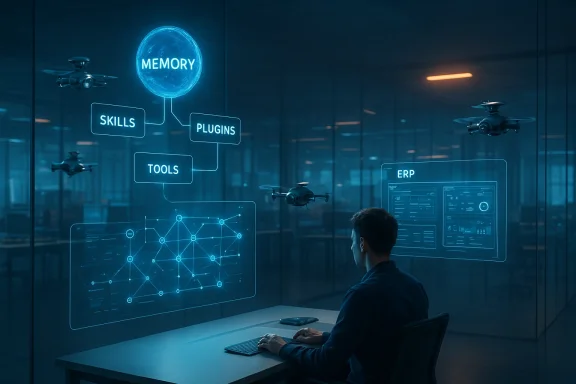

Die gängige Praxis bis 2025: ein Eingabefeld, eine Sitzung, eine Antwort. Die KI begann bei jeder Interaktion bei Null, ohne Kontext, ohne Kontinuität. Dieses Modell hat die früheste Produktivitätswelle ermöglicht — aber es hat auch das Potenzial vieler Systeme massiv gebremst. Inzwischen zeichnen sich drei strukturelle Innovationen ab, die 2026 die Spielregeln neu schreiben: persistente Erinnerungen (memory), modulare Skills/Plugins und agentische Autonomie. Diese Kombination verwandelt AI-Instanzern in proaktive, koordinierende Mitarbeitende.

Anthropic hat Claude in mehreren Schritten mit Memory‑Funktionen ausgestattet: erste Optionen für Enterprise/Team, später breitere Verfügbarkeit; im März 2026 folgte ein Import‑Tool, mit dem sich Kontexte aus anderen Diensten (etwa ChatGPT) übertragen lassen, sodass der „neue“ Assistent nicht mehr bei Null startet. Diese Entwicklung reduziert Re‑Briefing‑Aufwand und erhöht die Amortisationsgeschwindigkeit von KI‑Investitionen.

Wirtschaftlich heißt das konkret:

Vorteile modularer Skills:

Das bedeutet für Agentische Kreativ‑Teams:

Praktische Beispiele:

Wer jetzt investiert, sollte nicht in einzelne Tools, sondern in eine Agent‑fähige Infrastruktur investieren: Datenqualität, Governance, modulare Skills und beobachtbare, sichere Agenten‑Pipelines. Dann wird KI nicht länger als einmaliger Output‑Generator genutzt, sondern als mitdenkender Kollege, der wiederkehrende Aufgaben übernimmt, Kontext bewahrt und Menschen von Routinen befreit — sodass menschliche Arbeit wieder dort glänzt, wo Urteilsfähigkeit, Kreativität und Empathie gefragt sind.

Schlussendlich gilt: Die Technologie ist da — wer die Organisation, die Daten und die Governance nicht anpasst, verliert 2026 nicht nur Zeit, sondern nachhaltige Wettbewerbsfähigkeit.

Source: Xpert.Digital - Konrad Wolfenstein From tool to co-thinker: Why we are using AI completely wrong (and what will change in 2026)

Hintergrund / Überblick

Hintergrund / Überblick

Die gängige Praxis bis 2025: ein Eingabefeld, eine Sitzung, eine Antwort. Die KI begann bei jeder Interaktion bei Null, ohne Kontext, ohne Kontinuität. Dieses Modell hat die früheste Produktivitätswelle ermöglicht — aber es hat auch das Potenzial vieler Systeme massiv gebremst. Inzwischen zeichnen sich drei strukturelle Innovationen ab, die 2026 die Spielregeln neu schreiben: persistente Erinnerungen (memory), modulare Skills/Plugins und agentische Autonomie. Diese Kombination verwandelt AI-Instanzern in proaktive, koordinierende Mitarbeitende.Das Ende der Input‑Feld‑Ära: Warum ein Fenster nicht mehr reicht

Der typische Workflow 2025 sah so aus: Browser öffnen → Prompt schreiben → Antwort kopieren → Fenster schließen. Jedes Projekt war eine Neubeginn‑Performance. Das Problem war weniger technischer Natur als mental: Unternehmen behandelten KI wie einen Taschenrechner statt wie eine persistente Infostruktur.- Nutzer verloren Zeit mit wiederholtem Kontextaufbau.

- Konsistenz über Dokumente, Bilder oder Kampagnen hinweg war kaum erreichbar.

- Prozesse blieben fragmentiert: Zwischen Chat, Design-Tool und ERP‑Systtische, sichere Übergaben.

Memory als Produktionsfaktor: Warum Erinnerung wirtschaftlich ist

Persistente Gedächtnisse in KI sind keine nette Usability‑Verbesserung — sie sind ein neuer Produktionsfaktor. In Wissensarbeit unterscheidet Erfahrung von roher Intelligenz vor allem eines: angesammelter Kontext. Ein Mitarbeiter kennt Kundenhistorie, Abkürzungen, frühere Entscheidungen; ein gedächtnisloses Modell nicht.Anthropic hat Claude in mehreren Schritten mit Memory‑Funktionen ausgestattet: erste Optionen für Enterprise/Team, später breitere Verfügbarkeit; im März 2026 folgte ein Import‑Tool, mit dem sich Kontexte aus anderen Diensten (etwa ChatGPT) übertragen lassen, sodass der „neue“ Assistent nicht mehr bei Null startet. Diese Entwicklung reduziert Re‑Briefing‑Aufwand und erhöht die Amortisationsgeschwindigkeit von KI‑Investitionen.

Wirtschaftlich heißt das konkret:

- Weniger Zeit für Kontext‑Rekonstruktion.

- Höhere Wiederverwendbarkeit von Entscheider- und Projektwissen.

- Skalierbare Expertise: Ein einmal erstelltes „Memory“ wirkt wie ein gebündeltes, teilbares Know‑how‑Asset.

Spezialisierung durch modulare Intelligenz: Skills und Plugins

Der zweite Baustein sind modulare Skills: wiederverwendbare Kompetenz‑Pakete, die bestimmte Aufgaben standardisiert ausführen. Anthropic spricht von Agent Skills; diese lassen sich in verschiedenen Claude‑Umgebungen einsetzen — Web, Desktop, Code‑Integrationen und via API. Das macht Skills zu Infrastrukturkomponenten, vergleichbar mit Bibliotheken in der Softwareentwicklung.Vorteile modularer Skills:

- Einmal definierte Regeln, Prüfungen und Output‑Formate sind sofort organisatorisch nutzbar.

- Kombination mehrerer Skills ermöglicht mehrstufige, robuste Workflows.

- Portabilität: Skills lassen sich zwischen Tools und Teams verschieben.

Kreative Infrastruktur: Visual Workflows als Kapital

Im kreativen Bereich wandelt sich die Arbeit von täglicher Einzelleistung zu kapitalisierbarer Workflow‑Infrastruktur. Freepik Spaces — ein node‑basiertes Canvas, das im November 2025 vorgestellt wurde — ist ein praxisnahes Beispiel: Bildgenerierung, Upscaling, Editing und Video‑Ableitungen lassen sich als wiederverwendbare, kollaborative Pipelines abbilden. Ein gut konfigurierte Space ist kein Dokument; er ist ein Produktionsmittel, das im Unternehmen genutzt, veredelt und skaliert werden kann.Das bedeutet für Agentische Kreativ‑Teams:

- Konsistente Marken‑Outputs ohne tägliche Prompt‑Aneignung.

- Schnellere Iterationen durch versionierte Workflows.

- Eigentum an Produktionsprozessen statt an Einzelausgaben.

Agentic AI: Der Quantensprung vom Assistenten zum autonomen Akteur

Der Begriff, der 2026 alle IT‑Roadmaps prägt, ist agentische KI — Systeme, die eigenständig multi‑stufige Ziele verfolgen, zwischen Tools wechseln, Entscheidungen treffen und Aktionen automatisch durchführen. Lenovo‑Erhebungen (CIO Playbook 2026) zeigen: CIOs sehen Agentic AI als Top‑Priorität; 65 Prozent planen, agentische KI in den nächsten zwölf Monaten in Geschäftsprozesse zu skalieren; erwartete Rendite: etwa $2.78 pro investiertem Dollar. Diese Zahlen spiegeln die betriebswirtschaftliche Erwartungshaltung wider, die hinter der Investitionswelle steht.Praktische Beispiele:

- Instandhaltungs‑Agenten, die autonom Ersatzteile bestellen, Termine mit Technikern koordinieren und Dokumentationen aktualisieren.

- Multi‑Agent‑Orchestrierungen, bei denen ein Analyse‑Agent mit einem Procurement‑Agent kommuniziert und ein Abschluss‑Agent automatisiert den Auftrag auslöst.

- Marketing‑Agenten, die Budgets in Echtzeit umschichten, A/B‑Tests starten und KPIs automatisch reporten.

Ökonomische Fallstudien: Wo die Zahlen sprechen

Anthropic hat Claude gezielt für den Finanzsektor ausgerollt — mit dokumentierten Erfolgen. Berichte und Fallstudien zeigen:- Die norwegische Staatsfondsgesellschaft (NBIM) erwähnt Produktivitätsgewinne im Bereich von ~20% bzw. Hunderttausenden Stunden, die anderswo eingespart wurden.

- AIG erklärte, dass Underwriting‑Reviews in frühen Rollouts um mehr als das Fünffache beschleunigt wurden, während die Datenqualität von etwa 75% auf über 90% stieg. Solche Verbesserungen lassen sich — in Finanz‑ und Versicherungsprozessen — direkt in Zeit- und Kosteneinsparungen übersetzen.

- Viele Berichte stammen aus Anbieter‑Statements oder frühen Implementierungen.

- Externe Validierung fehlt noch für eine breite statistische Generalisierung.

Deshalb: Erfolgsgeschichten sind valide Indikatoren — aber keine Garantie für jede Organisation.

Governance, Sicherheit und Datenqualität: Die Achillesferse der Agentenära

Die neuen Fähigkeiten bringen neue Risiken. Drei Punkte sind besonders kritisch:- Datenqualität und Integrität

Agentische KI operiert auf Basis von Datenpipelines. Schlechte, veraltete oder fragmentierte Daten führen zu falschen Entscheidungen — und Agenten skalieren Fehler mit Maschinen‑Tempo. Gartner und andere Analysen sehen schlechte Datenqualität als Hauptursache für Projektabbrüche. - Governance und Verantwortlichkeit

Wer entscheidet, wenn ein Agent autonom einen Vertrag freigibt? Wer haftet bei fehlerhaften Entscheidungen? Ohne eindeutige SLOs, Audit‑Trails und Eskalationspfade drohen regulatorische und rechtliche Probleme. - Angriffsfläche und Compliance

Agenten, die zwischen internen Systemen, Cloud‑Services und externen APIs vermitteln, erweitern die Angriffsfläche massiv. Patch‑Zyklen, Zugriffsrechte und Geheimnisverwaltung müssen agent‑aware werden.

Transition: Wie Unternehmen von Tool zu System wechseln

Die Transformation ist weniger eine Technologie‑ als eine Organisationsfrage. Ein pragmatisches Fahrplan‑Gerüst:- Priorisieren statt experimentieren

Wählen Sie 2–3 Kernprozesse mit klar messbarer KPI‑Baseline (z. B. Durchlaufzeit, Fehlerquote). Agentische Automatisierung zuerst dort einsetzen, wo Metriken die Wirkung belegen. - Treat AI as an employee — Onboarding & KPIs

Agenten brauchen Onboarding: Rollen, KPIs, Sicherheitstests, Review‑Zyklen. Behandeln Sie Agenten wie Junior‑Mitarbeiter mit klaren Verantwortlichkeiten. - Dateninfrastruktur modernisieren

Investieren Sie in saubere Datenpipelines, eindeutige IDs, Versionierung und Observability‑Tools für LLM‑Workflows. - Governance‑Frameworks aufsetzen

Definieren Sie Escalation‑Paths, Audit‑Logs, menschliche Checkpoints für risky decisions und Exit‑Strategien für fehlerhafte Agenten. - Modulbasierte Skills entwickeln

Starten Sie mit einer handvoll wiederverwendbarer Skills (z. B. Vertragsprüfung, Kontext‑Extraction), die teams übergreifend einsetzbar sind. - Security‑by‑Design implementieren

Minimale Berechtigungen, Secrets‑Rotation, Monitoring für ungewöhnliche Agenten‑Aktionen. - Messen, lernen, skalieren

Führen Sie kontinuierliche Messungen ein und skalieren Sie nur wenn die KPIs stabil positive Effekte zeigen.

Risiken für Jobs und Arbeitsorganisation

Agentische Systeme werden Routineaufgaben in hoher Geschwindigkeit übernehmen — das ist unstrittig. Was sich ändert, ist jedoch vor allem die Verteilung der Arbeit:- Routine & Repetition → Automatisiert

- Komplexe Urteilsaufgaben → menschliche Domäne, aber unterstützt durch Agenten

- Neue Rollen: Agent‑Kurator, Prompt‑Engineer als Prozessdesigner, Observability‑Specialist

Chancen für CIOs und IT‑Teams: Wer jetzt vorbereitet, gewinnt

Lenovo‑Daten zeigen, dass CIOs Agentic AI als Chance sehen — aber viele sind organisatorisch unvorbereitet. Die Opportunität gehört denen, die früh die Infrastruktur, Governance und Change‑Management‑Routinen schaffen. Kurzfristige Effekte:- Schnelle Effizienzgewinne in Fachabteilungen (Finance, Legal, Customer Service).

- Wettbewerbsvorteil durch Kapitalisierung von Workflow‑Assets (z. B. Freepik Spaces als Creative‑Asset).

- Langfristiger Ertragshebel durch skalierbare Skills‑Bibliotheken.

Was CIOs heute konkret tun sollten (checkliste)

- Auditieren: Welche Prozesse haben klar messbare KPIs?

- Testen: Pilot mit begrenztem Scope + striktem Audit‑Logging.

- Daten‑Upgrade: Masterdata‑Bereinigung und Observability.

- Governance: Rollen, Approval‑Gates, Escalation.

- Security: Least‑privilege, Secrets‑Management, Agent‑WAF/Monitoring.

- Skills‑Strategie: Standardisieren, dokumentieren, versionieren.

- Change: Upskilling‑Programme für Mitarbeiter, die mit Agenten kollaborieren.

Fazit — Vom Werkzeug zum Mitdenker: Ein kultur‑ und architekturgetriebener Wandel

2026 markiert nicht das Ende der KI‑Adoption, sondern den Beginn ihrer Industrialisierung. Persistent Memory, modulare Skills und agentische Autonomie zusammen erzeugen eine neue Klasse von Systemen: den digitalen Mitarbeiter, der kontextbewusst, handlungsfähig und skalierbar ist. Die Chancen sind enorm — von massiven Produktivitätsgewinnen bis zu neuen Geschäftsmodellen im Finanz‑ und Kreativsektor. Die Risiken sind real — schlechte Daten, fehlende Governance und Sicherheitslücken können Projekte scheitern lassen, wie Gartner warnt.Wer jetzt investiert, sollte nicht in einzelne Tools, sondern in eine Agent‑fähige Infrastruktur investieren: Datenqualität, Governance, modulare Skills und beobachtbare, sichere Agenten‑Pipelines. Dann wird KI nicht länger als einmaliger Output‑Generator genutzt, sondern als mitdenkender Kollege, der wiederkehrende Aufgaben übernimmt, Kontext bewahrt und Menschen von Routinen befreit — sodass menschliche Arbeit wieder dort glänzt, wo Urteilsfähigkeit, Kreativität und Empathie gefragt sind.

Schlussendlich gilt: Die Technologie ist da — wer die Organisation, die Daten und die Governance nicht anpasst, verliert 2026 nicht nur Zeit, sondern nachhaltige Wettbewerbsfähigkeit.

Source: Xpert.Digital - Konrad Wolfenstein From tool to co-thinker: Why we are using AI completely wrong (and what will change in 2026)